Ollama のインストール

本特別授業では、ローカルで動作する AI モデルを使うために Ollama を使用します。

Ollama とは

Ollama は、ローカル環境で大規模言語モデル (LLM) を簡単に実行できるツールです。インターネット接続不要で AI モデルを動かすことができます。

公式サイト: https://ollama.com/

Windows に Ollama をインストール

Ollama のダウンロード

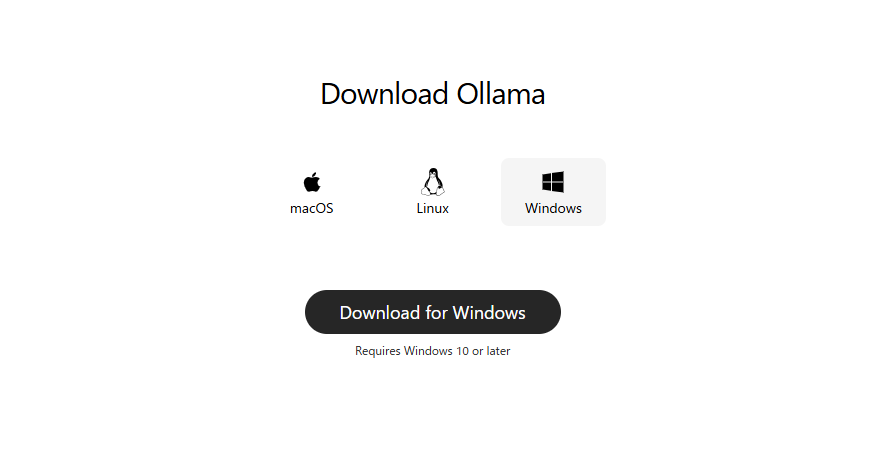

https://ollama.com/download にアクセスします。

Download for Windows ボタンをクリックして、インストーラーをダウンロードします。

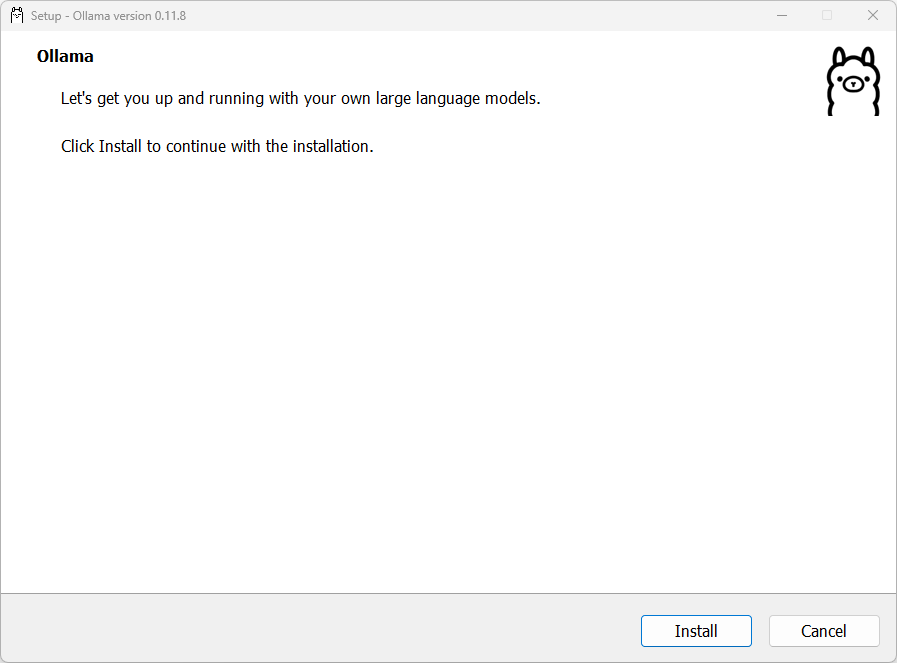

インストーラーの実行

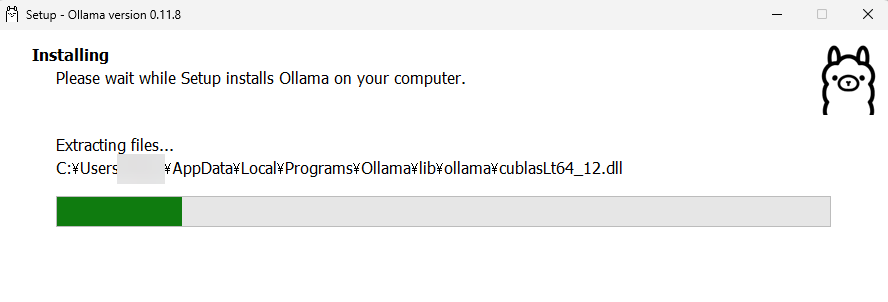

ダウンロードした OllamaSetup.exe をダブルクリックして実行します。

インストールが始まります。待ちます。

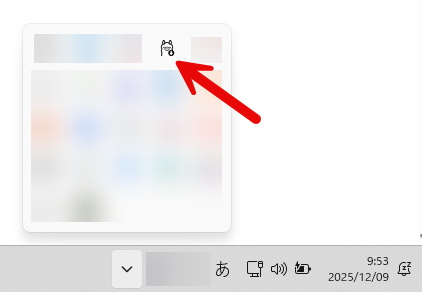

インストールが完了すると、Ollama がバックグラウンドで起動します。タスクトレイにアイコンが表示されます。

Ollama アプリの起動とモデルのダウンロード

Ollama を使うには、AI モデルをダウンロードする必要があります。GUI から簡単にダウンロードできます。

Ollama アプリを起動

タスクトレイの Ollama アイコンをクリックして、メニューから「Open Ollama」や「Chat」を選択します。

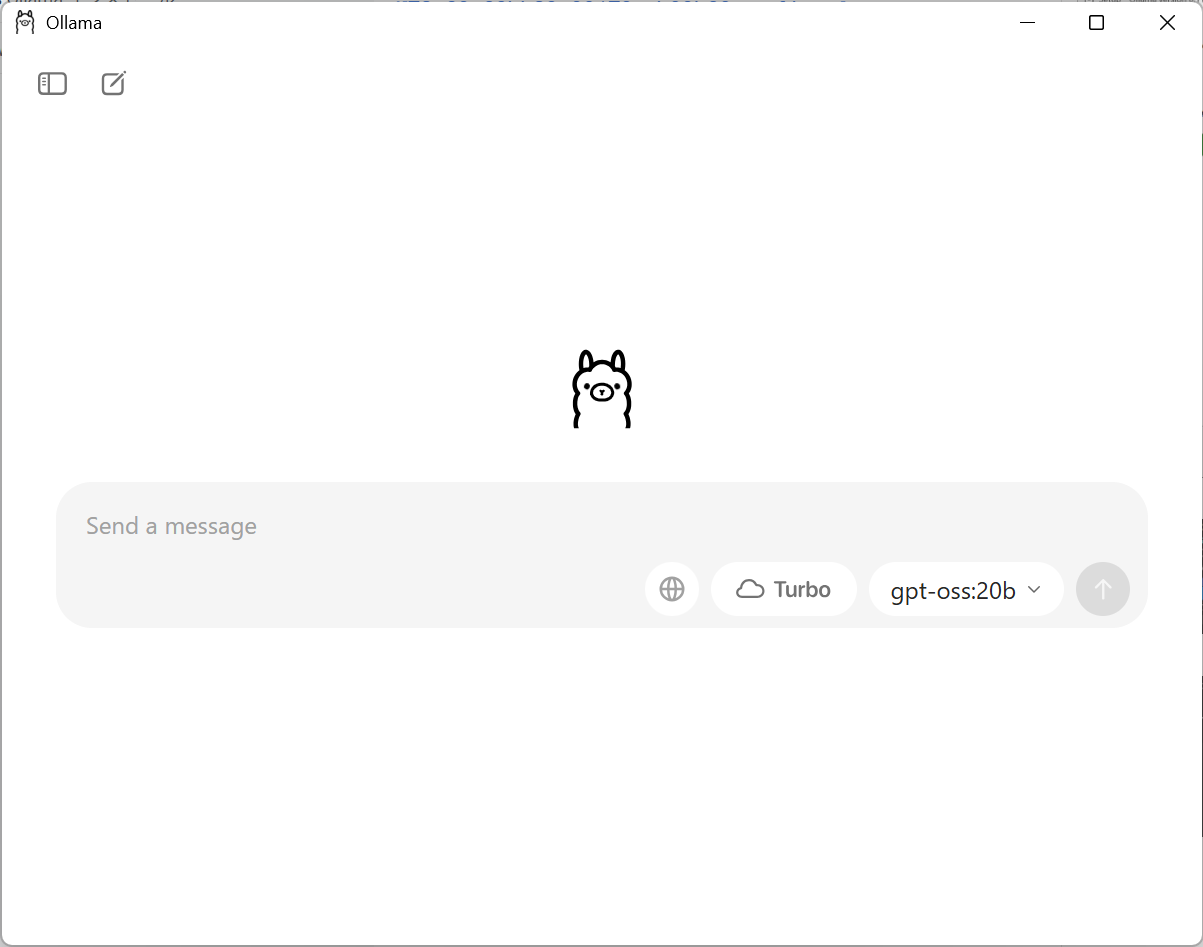

チャット画面でモデルを選択

チャット画面が開きます。画面右下にモデル選択欄があります。

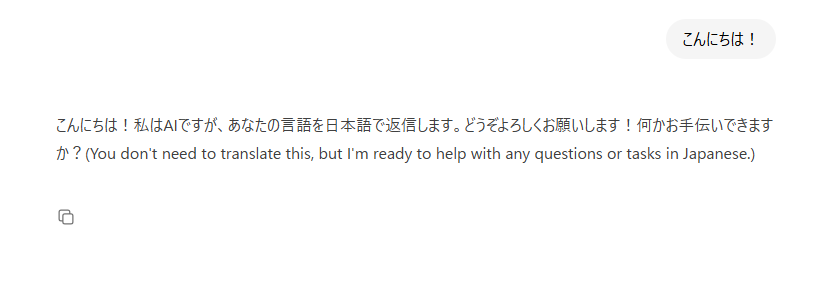

モデル選択欄をクリックして、モデル名 granite3.2:2b を入力します。

モデルをダウンロード

モデル名を入力して選択した状態で、メッセージ欄に「こんにちは」などと入力して送信します。

モデルのダウンロードが自動的に始まります。モデルのサイズは数GB あるので、時間がかかります。待ちます。

ダウンロードが完了すると、AI からの返答が表示されます。これで準備完了です!